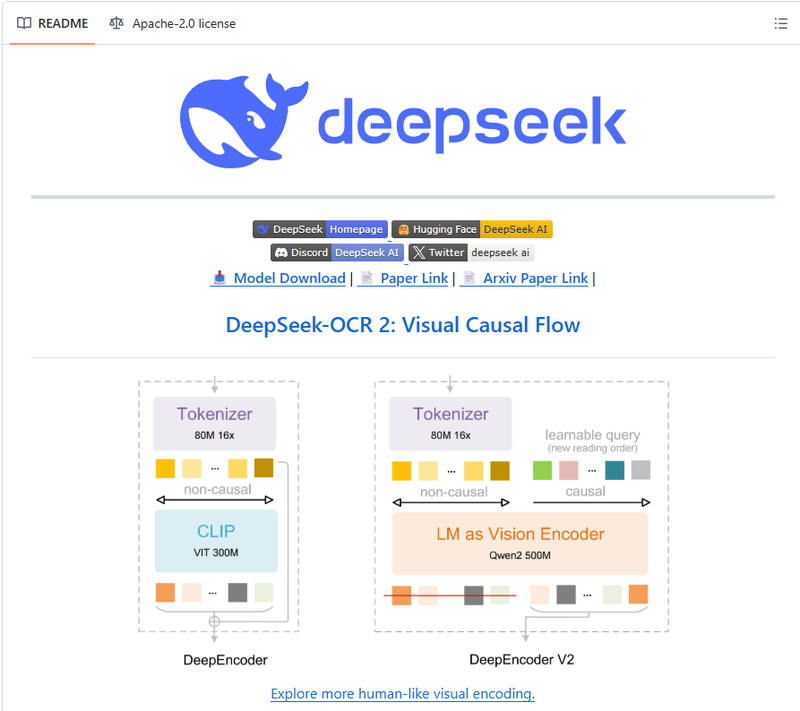

2026年开始不到一个月,DeepSeek公布了两份由创始人梁文峰签署的文件。元旦那天,我们发表了一篇关于解决模型稳定性问题的 mHC 架构的论文。 5月中旬,我们基于Engram的论文提出了一个新的想法:将静态知识存储为可搜索的内存表。 1月27日,DeepSeek发布开源模型DeepSeek-OCR 2,其核心在于静态图像处理,并同步发表论文《DeepSeek-OCR 2: Visual Causal Flow》。新京报贝壳财经记者看到该论文发现,视觉因果流机制使得模型能够像人类阅读一样基于语义和逻辑关系来理解图像的内容,而不是像扫描仪那样按像素顺序“扫描”图像,从而大大提高了表格、文档、数学公式等复杂结构场景的识别效果和理解能力。 DeepSeek最新文章截图github平台上的le显示,并不是模型不够强大,而是照片显示的顺序不正确。长期以来,主要的视觉语言模型在处理图像时都采用固定的像素扫描顺序。将图像划分为多个视觉单元后,我们从左到右、从上到下输入模型。虽然这种方法仍然适用于自然图像,但对于表格、多列文档、技术信息和公式等结构化内容有明显的局限性。在这些场景中,信息之间通常存在清晰的语义层次结构和逻辑依赖关系,例如标题和文本、行名称和值以及关键表达式和注释。然而,固定的空间秩序无法加强这些关系。结果,模型可以识别局部文本,但很难恢复整体结构,影响后续的理解和推理。尽管模型的规模仍在不断扩大折,这个问题还没有从根本上解决。研究人员越来越意识到,性能瓶颈的原因不仅仅是参数数量或计算能力不足,而是视觉信息的组织方式和输入模型本身的方式。我做到了。换句话说,你可以“看到”模型,但关键是“你怎么看”。在此背景下,提出了 DeepSeek-OCR 2。我们不再继续依赖更大的模型来弥补结构理解的缺乏,而是寻求从根本上微调模型的图像理解。先理清关系,然后让模型“理解”它们。在此背景下,DeepSeek-OCR 2的主要创新目的是提出“视觉因果流”机制。这使得模型能够根据语义和逻辑关系动态组织视觉信息,而不是按像素顺序机械地处理图像。在具体实现上,模型引入视觉编码阶段的语义和因果识别能力,并使用增强的视觉编码器对不同视觉单元之间的依赖关系进行建模,并确定哪些信息最好理解以及哪些内容是前者的补充或扩展。基于这一判断,模型动态地重新组织视觉标记,并将它们与可重构的位置编码相结合,将序列转变为结构更清晰的序列。语言模型。这样,语言模型在生成和推理阶段接收到的不再是混乱的像素序列,而是一条更接近人类阅读习惯的“理解路径”。研究人员将这一过程总结为“视觉因果流”,即图像中隐含的语义理解顺序。实验结果表明,该机制在分析表格、理解多列文档、识别数学表达式等任务中效果良好。比较机智与上一代DeepSeek-OCR相比,整体性能提升了3.73%,阅读顺序(R-order)的编辑距离(ED)也显着降低(从0.085到0.057)。这表明新的DeepEncoder V2可以根据图像信息有效地选择和放置初始视觉标记。该论文的结论是,光学字符识别,尤其是文档分析,是大规模模型时代最实用的视觉任务之一,但它只是更广泛的视觉领域的一部分。未来,相关架构将持续优化并扩展到更复杂的场景,进一步挖掘多模态智能在深度视觉理解方面的潜力。新京报贝壳财经记者 罗一丹 实习生 郭文华 编辑 王靖宇 校对 薛金宁

2026年开始不到一个月,DeepSeek公布了两份由创始人梁文峰签署的文件。元旦那天,我们发表了一篇关于解决模型稳定性问题的 mHC 架构的论文。 5月中旬,我们基于Engram的论文提出了一个新的想法:将静态知识存储为可搜索的内存表。 1月27日,DeepSeek发布开源模型DeepSeek-OCR 2,其核心在于静态图像处理,并同步发表论文《DeepSeek-OCR 2: Visual Causal Flow》。新京报贝壳财经记者看到该论文发现,视觉因果流机制使得模型能够像人类阅读一样基于语义和逻辑关系来理解图像的内容,而不是像扫描仪那样按像素顺序“扫描”图像,从而大大提高了表格、文档、数学公式等复杂结构场景的识别效果和理解能力。 DeepSeek最新文章截图github平台上的le显示,并不是模型不够强大,而是照片显示的顺序不正确。长期以来,主要的视觉语言模型在处理图像时都采用固定的像素扫描顺序。将图像划分为多个视觉单元后,我们从左到右、从上到下输入模型。虽然这种方法仍然适用于自然图像,但对于表格、多列文档、技术信息和公式等结构化内容有明显的局限性。在这些场景中,信息之间通常存在清晰的语义层次结构和逻辑依赖关系,例如标题和文本、行名称和值以及关键表达式和注释。然而,固定的空间秩序无法加强这些关系。结果,模型可以识别局部文本,但很难恢复整体结构,影响后续的理解和推理。尽管模型的规模仍在不断扩大折,这个问题还没有从根本上解决。研究人员越来越意识到,性能瓶颈的原因不仅仅是参数数量或计算能力不足,而是视觉信息的组织方式和输入模型本身的方式。我做到了。换句话说,你可以“看到”模型,但关键是“你怎么看”。在此背景下,提出了 DeepSeek-OCR 2。我们不再继续依赖更大的模型来弥补结构理解的缺乏,而是寻求从根本上微调模型的图像理解。先理清关系,然后让模型“理解”它们。在此背景下,DeepSeek-OCR 2的主要创新目的是提出“视觉因果流”机制。这使得模型能够根据语义和逻辑关系动态组织视觉信息,而不是按像素顺序机械地处理图像。在具体实现上,模型引入视觉编码阶段的语义和因果识别能力,并使用增强的视觉编码器对不同视觉单元之间的依赖关系进行建模,并确定哪些信息最好理解以及哪些内容是前者的补充或扩展。基于这一判断,模型动态地重新组织视觉标记,并将它们与可重构的位置编码相结合,将序列转变为结构更清晰的序列。语言模型。这样,语言模型在生成和推理阶段接收到的不再是混乱的像素序列,而是一条更接近人类阅读习惯的“理解路径”。研究人员将这一过程总结为“视觉因果流”,即图像中隐含的语义理解顺序。实验结果表明,该机制在分析表格、理解多列文档、识别数学表达式等任务中效果良好。比较机智与上一代DeepSeek-OCR相比,整体性能提升了3.73%,阅读顺序(R-order)的编辑距离(ED)也显着降低(从0.085到0.057)。这表明新的DeepEncoder V2可以根据图像信息有效地选择和放置初始视觉标记。该论文的结论是,光学字符识别,尤其是文档分析,是大规模模型时代最实用的视觉任务之一,但它只是更广泛的视觉领域的一部分。未来,相关架构将持续优化并扩展到更复杂的场景,进一步挖掘多模态智能在深度视觉理解方面的潜力。新京报贝壳财经记者 罗一丹 实习生 郭文华 编辑 王靖宇 校对 薛金宁